CentOS双ISP配置

CentOS双ISP配置

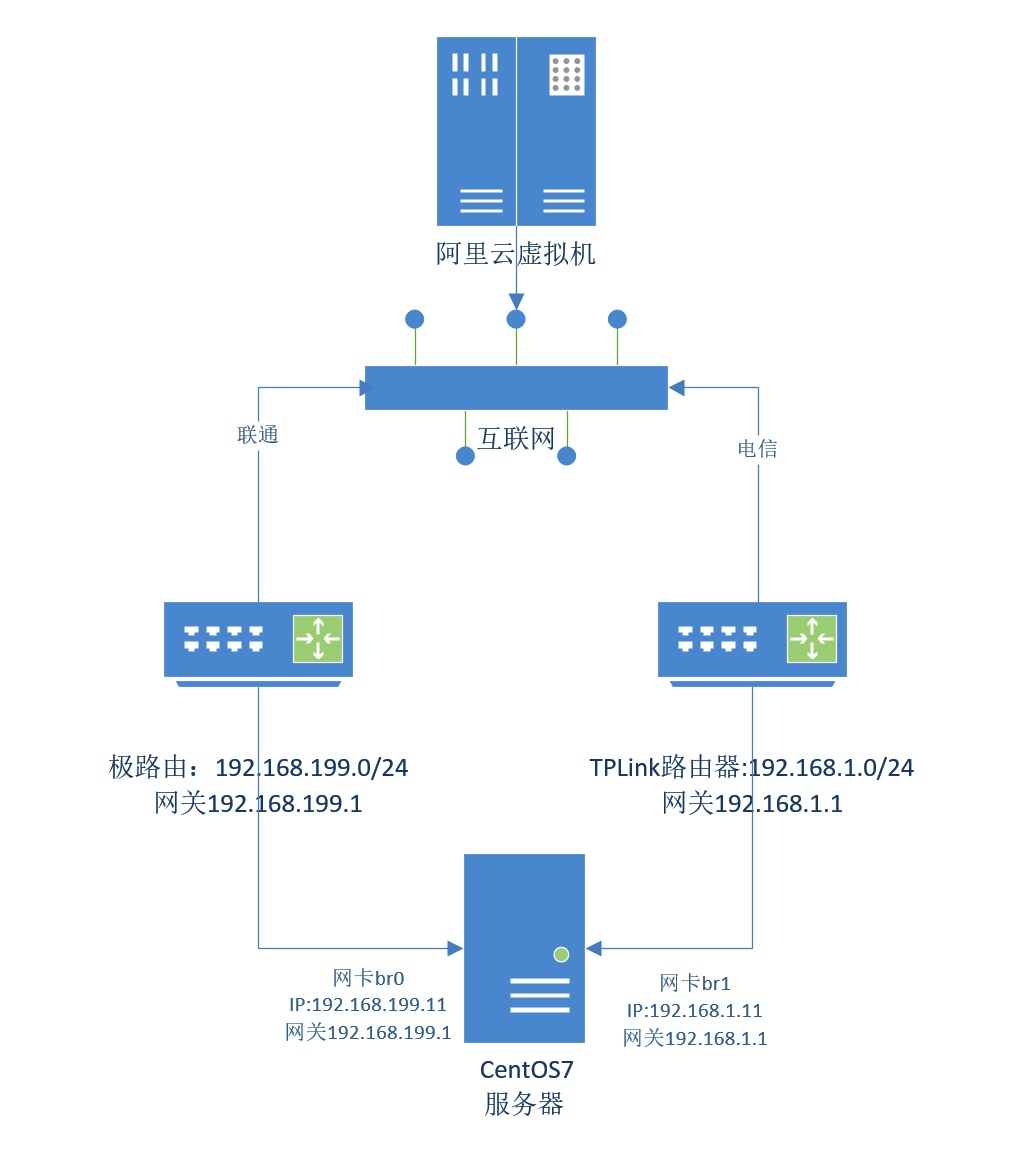

目标: 一台服务器通过多个网卡连接多个网络,能够保证不同网络的来的数据能够按照原路返回,同时通过这两个网络中任意一个的外网ip或域名访问正常。

环境

网络环境:

- 两个网段192.168.199.0/24 192.168.1.0/24,两个网段物理隔离,分别从两个不同的ISP供应商连接互联网。

- TPlink路由器绑定域名 longxintaiye.f3322.net

- 极路由绑定域名 longsun.jios.org

- 服务器:

- 操作系统: CentOS 7 minimal

- 两个物理网卡分别绑定两个网桥br0 br1,实际相当于两个物理网卡(后面直接把网桥当作物理网卡来理解)

- br0连接极路由:ip 192.168.199.11 通过极路由映射端口22,外网访问地址为 longsun.jios.org:1122

- br1连接路由器TPLink:ip 192.168.1.11 通过TPLink映射端口22,外网访问地址为 longxintaiye.f3322.net:1122

- 测试机

- 阿里云服务器,CentOS 7 安装Telnet 外网测试访问22端口是否能通

iproute2 与 route命令

- route命令属于net-tools工具包的一个命令,从2001年不再维护,很多linux内核支持的新的网络特性无法通过route命令实现

iproute2从centos7以后替换net-tools工具的成为系统默认网络工具,支持route策略配置及流量控制等功能

为什么只有用iproute2的ip命令才能够解决双路问题?

- ip route 命令支持定义多张路由表,每个路由表都可以自由设定默认路由静态路由等策略

ip rule 支持定义策略,将不同类型的网络数据跟不同路由表绑定,例如:

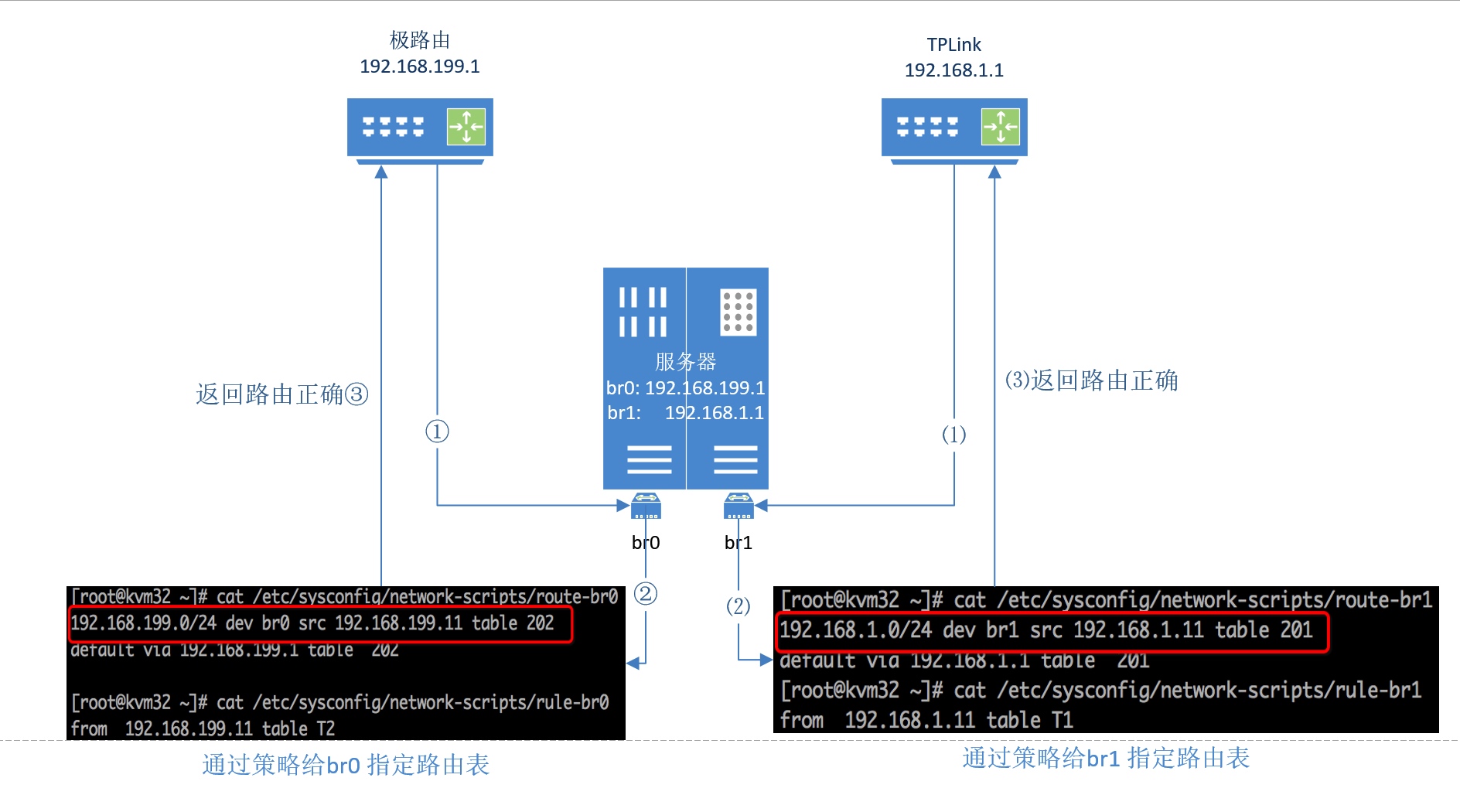

- 极路由192.168.199.0/24网络里发送到br0网卡上的数据包,会根据br0的路由表T2(自定义标号为202)指定的网关192.168.199.1返回极路由;

- TPLink路由器中192.168.1.0/24网络里发送到br1网卡的数据包会根据br1对应的路由表T1(自定义标号为201)中的默认网关192.168.1.1,发送回TPLink;

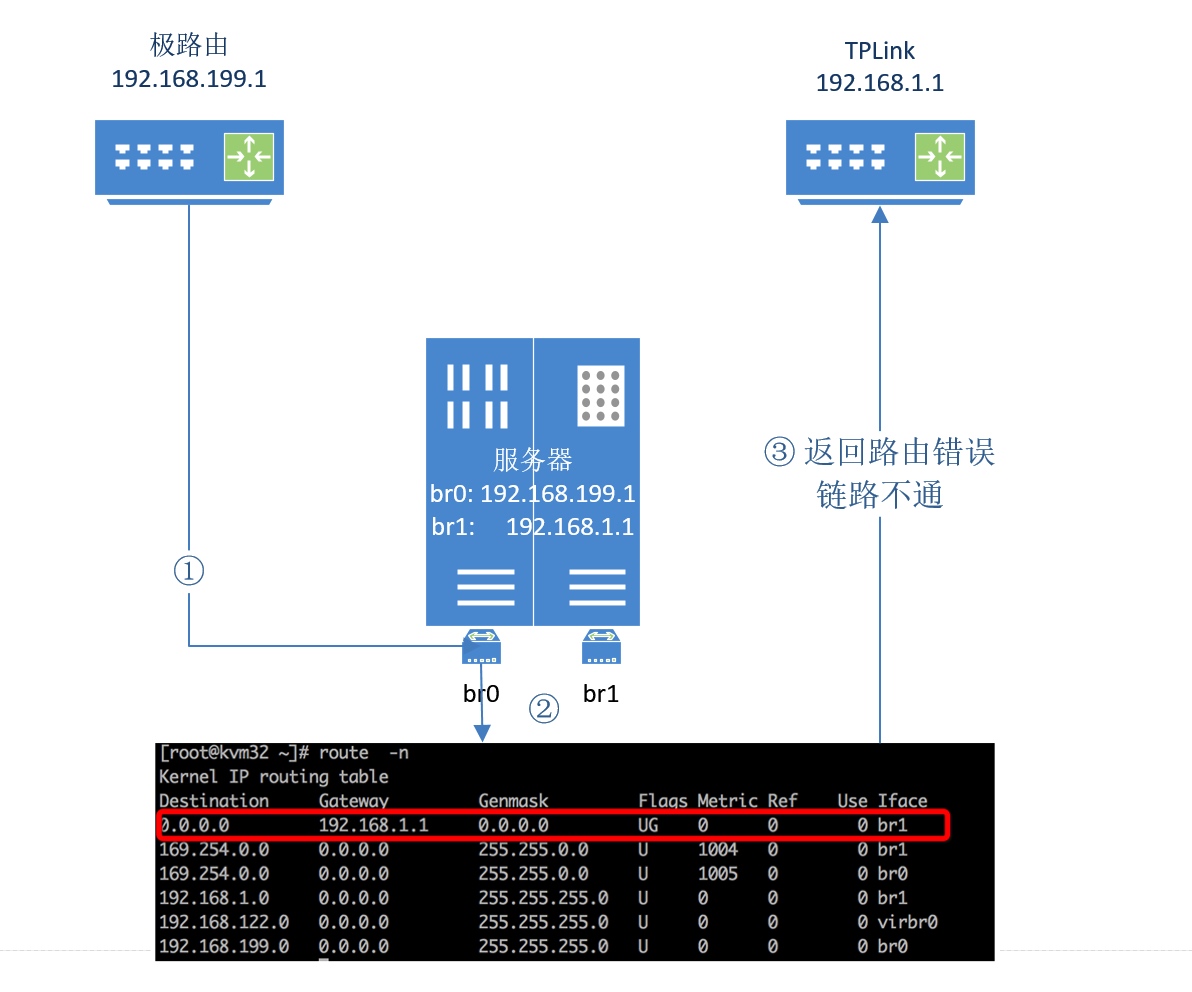

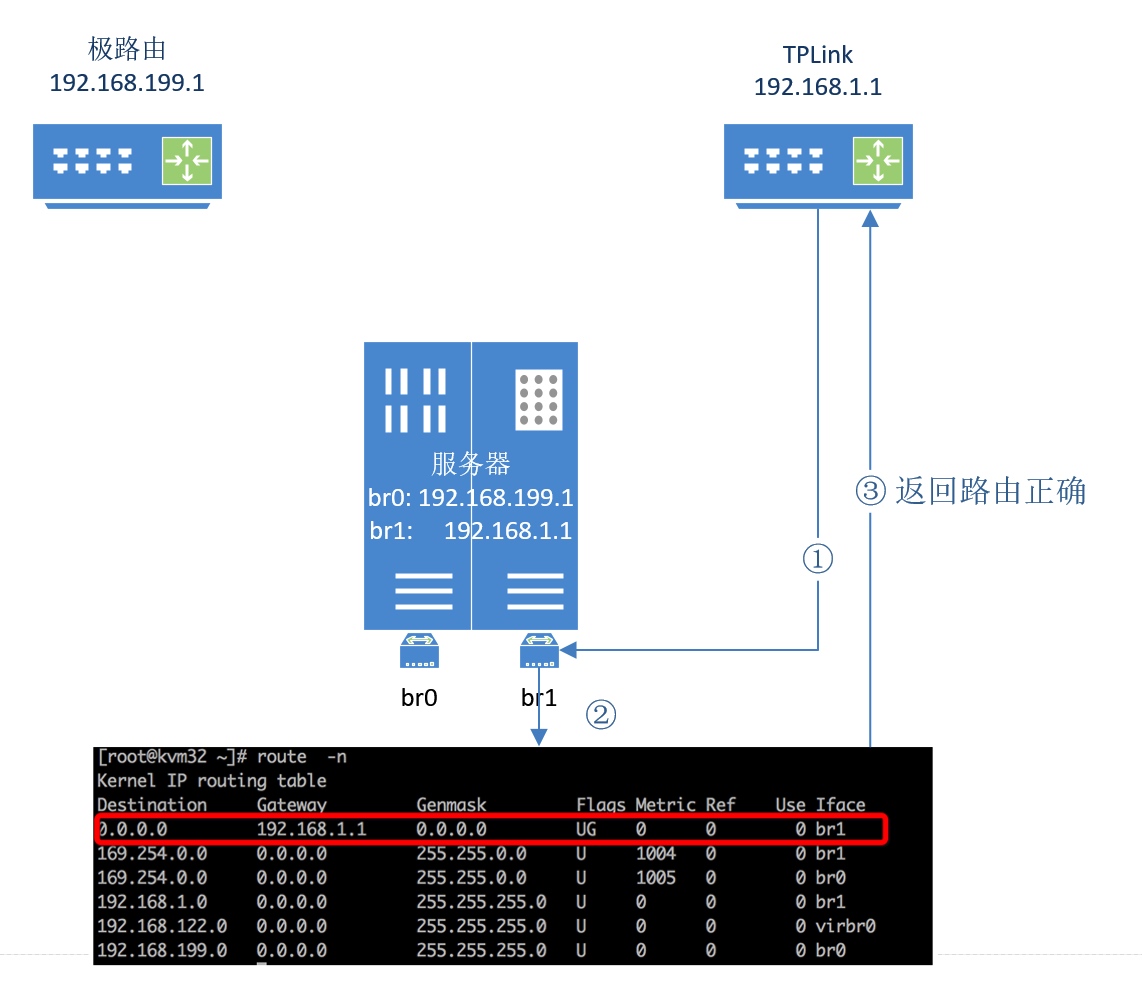

- route只能维护一张路由表,只能有一个默认网关比如:192.168.1.1

- TPLink路由器发送到br1网卡的数据包,会根据默认路由表中的网关送回到192.168.1.1 TPLink去,此时链路正常

- 极路由发送到br0网卡的数据包,会根据route的默认路由表中的网关送回到192.168.1.1, TPLink没有接受过这个数据包,也无法获取源地址正确的转回去。

如何配置iproute2

为物理网卡创建单独的路由表

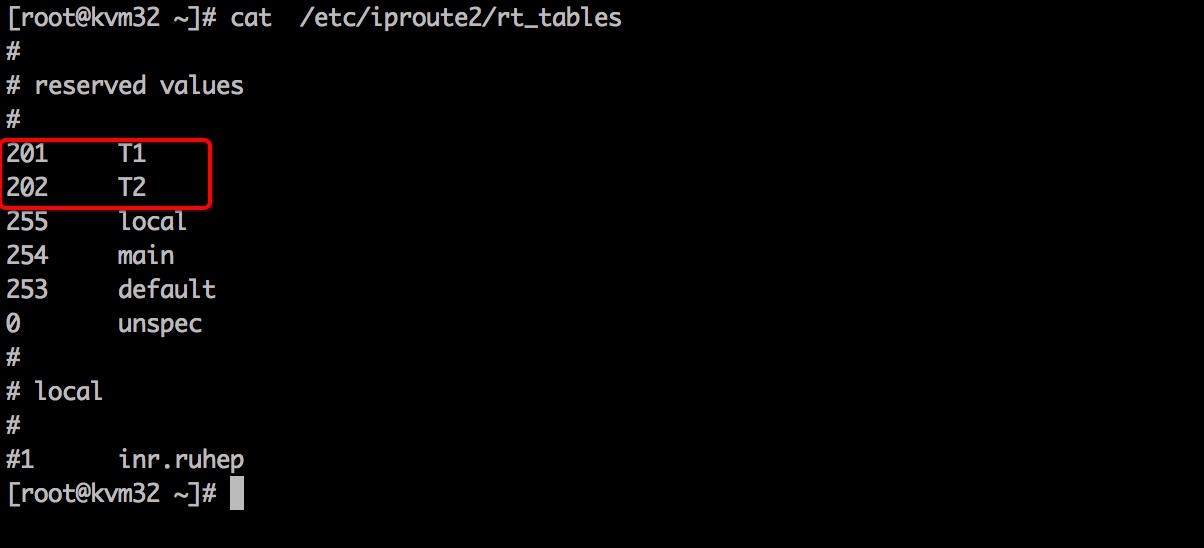

iproute定义路由表的配置文件在/etc/iproute2/rt_table,最多可以有255个路由表。我们只需要分别为br1 br0创建T1 T2路由表,编辑/etc/iproute2/rt_table并添加201 T1 202 T2保存退出即可

分别为向新创建的路由表添加路由规则(非持久化,重启机器或网络后失效)

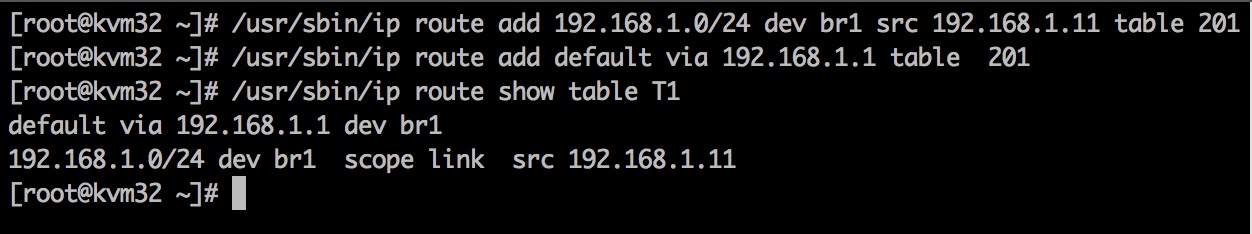

为br1添加路由规则到T1表中

#将从192.168.1.11来到数据包指定到br1网卡上/usr/sbin/ip route add 192.168.1.0/24 dev br1 src 192.168.1.11 table 201#指定本路由表默认网关为192.168.1.1/usr/sbin/ip route add default via 192.168.1.1 table 201#查看路由表/usr/sbin/ip route show table T1为br0添加路由规则到T2表中

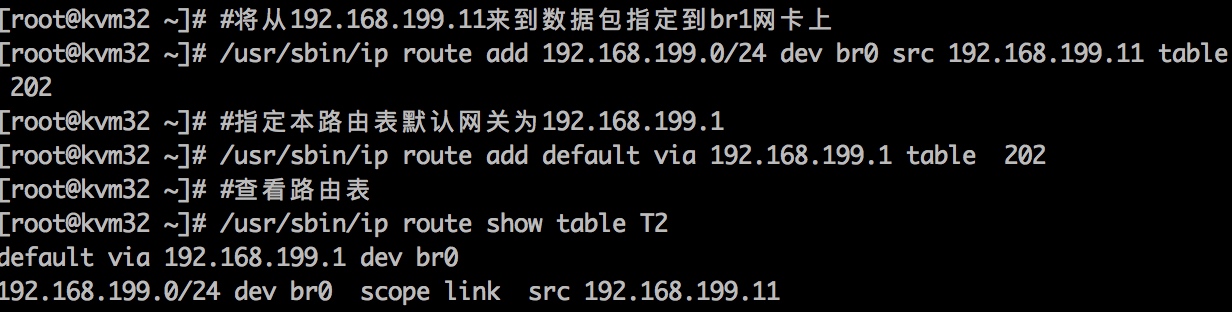

#将从192.168.199.11来到数据包指定到br1网卡上/usr/sbin/ip route add 192.168.199.0/24 dev br0 src 192.168.199.11 table 202#指定本路由表默认网关为192.168.199.1/usr/sbin/ip route add default via 192.168.199.1 table 202#查看路由表/usr/sbin/ip route show table T2通过ip rule制定策略,将路由表与网络数据绑定(非持久化,重启机器或网络后失效)

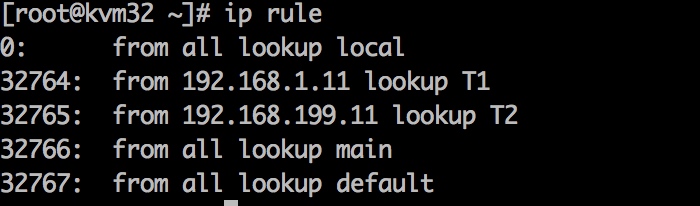

将来自于网关192.168.1.1的数据包绑定到路由表T1上,按照T1的路由规则执行

/usr/sbin/ip rule add from 192.168.1.11 table T1将来自于网关192.168.199.1的数据包绑定到路由表T2上,按照T1的路由规则执行

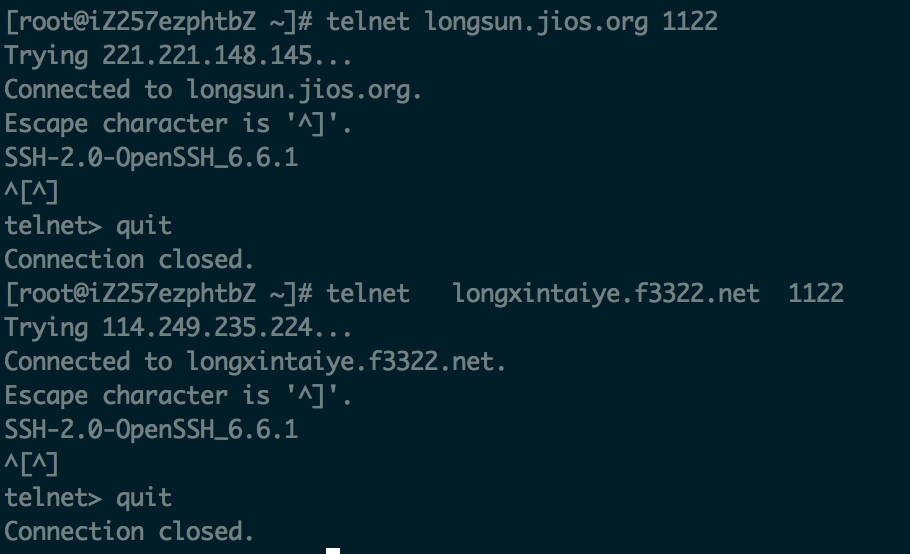

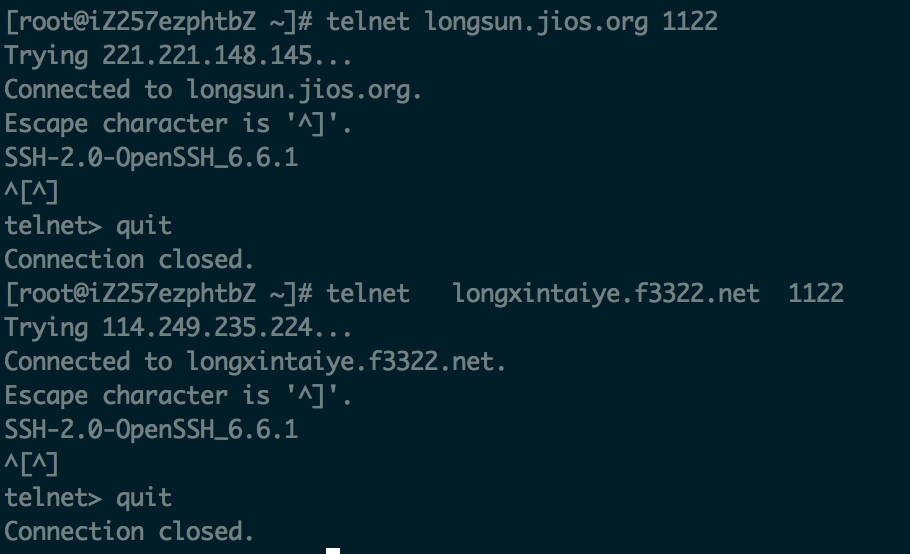

/usr/sbin/ip rule add from 192.168.199.11 table T2测试

在阿里云的主机上通过telnet命令测试,服务器域名及服务器在两个路由器上对应的外网映射端口,如果有交互操作说明可以连通,注意关闭服务器上的防火墙。

iproute定义的route 和rule持久化,避免重启机器或网络后失效

新增路由表

echo " 201 T1202 T2" >> cat /etc/iproute2/rt_tables为br0 br1 创建route规则配置文件

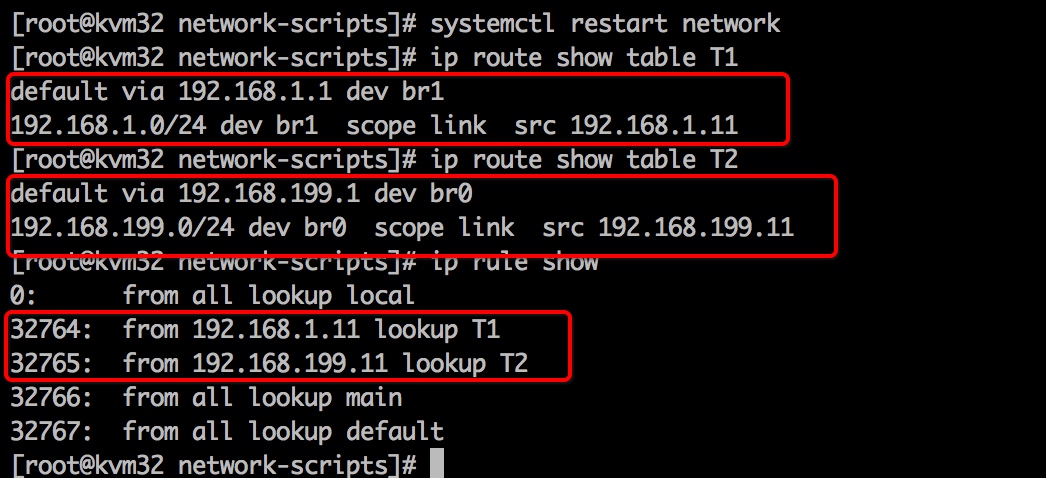

echo "192.168.199.0/24 dev br0 src 192.168.199.11 table 202default via 192.168.199.1 table 202" > /etc/sysconfig/network-scripts/route-br0echo "192.168.1.0/24 dev br1 src 192.168.1.11 table 201default via 192.168.1.1 table 201" > /etc/sysconfig/network-scripts/route-br1创建rule规则文件

echo "from 192.168.199.11 table T2" > /etc/sysconfig/network-scripts/rule-br0echo "from 192.168.1.11 table T1" > /etc/sysconfig/network-scripts/rule-br1重启网络检查路由配置情况

systemctl restart networkip route show table T1ip route show table T2ip rule show- 从外网测试连接成功

centos终于可以像windows一样自动判断来源网卡设定回归的路由

route命令的缺陷

route命令创建的路由表相当于,iproute2中的main路由表,只能设置一个网关,会根据default网关的添加顺序及metric权重值来取做唯一的网关,一般情况下最后添加的及metric最小的默认路由生效

]]>